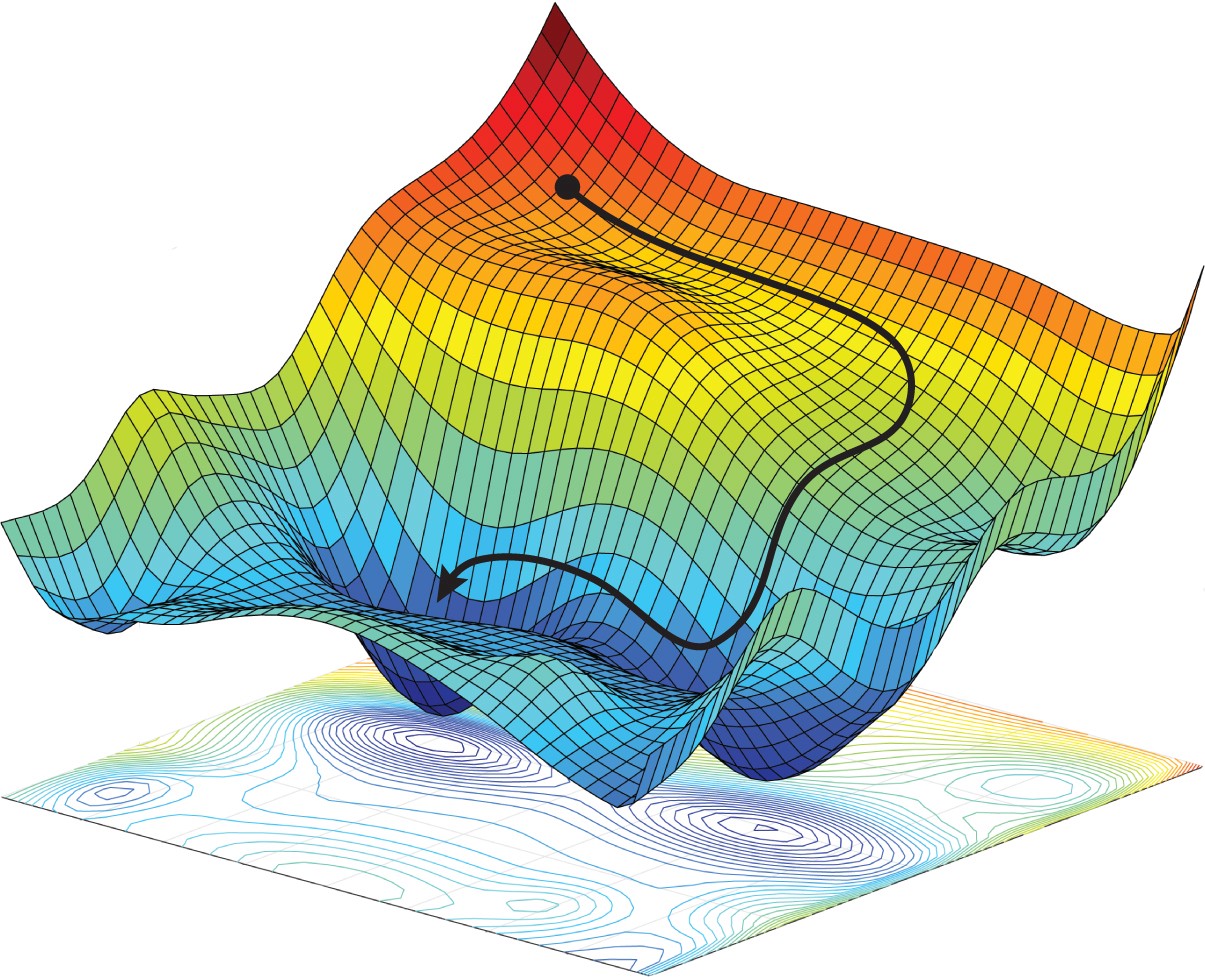

목차 0. 학습 목표 1. 선형 회귀 2. 정규 방정식 3. 경사하강법 4. 로지스틱 회귀 0. 학습 목표 최적화(optimization)란, loss 함수(손실함수, 비용함수)를 최소화하는 parameter를 구하는 과정입니다. 딥러닝 네트워크에서는 예측값과 실제값을 loss 함수를 통해 비교하며 예측값과 실제값이 가까워지도록, 즉 loss 함수가 최소가 되도록 parameter를 업데이트합니다. 가장 간단한 모델 중 하나인 선형 회귀로부터 직접 계산할 수 있는 공식을 사용하여 훈련 세트에 대해 loss 함수를 최소화하는 parameter를 해석적으로 구합니다. 반복적인 최적화 방식-경사 하강법(gradient descent)-을 사용하여 parameter를 조금씩 바꾸면서 loss 함수를 최소화시키는..